一种基于区域和Contourlet变换的多聚焦图像融合新方法

【摘要】 本文提出了一种基于区域和contourlet变换相结合的图像融合新方法。该方法首先对源图像进行contourlet变换,得到高频和低频图像;接着根据各尺度上高频图像的大小来调整源图像尺寸进行分割,得到多尺度分割图像;然后采用区域高频系数绝对值之和作为区域活动度来指导系数融合;最后进行contourlet逆变换得到融合图像。采用均方根误差、信噪比、边缘融合质量指标和加权融合质量指标4种准则来评价融合算法的性能。实验结果表明,本文方法不仅在客观评价指标上优于小波变换法,而且从主观评价上来看,本文的方法得到的融合图像更加的清晰。

【关键词】 Contourlet变换; 图像融合; 小波变换

Abstract: A New method for multi?focus image fusion based on contourlet transform and region is proposed. Firstly, contourlet transform is performed on source images to get high?frequency and low?frequency images. The source images are resized depending on the size of high?frequency images at each scale and then they are segmented into different regions. The sum of absolute value of high frequency coefficients in a region is considered as the region activity to conduct coefficient fusion. At the end, the inverse contourlet transform is utilized to obtain fused image. The performance of the image fusion method is evaluated using four criteria including root mean square error, signal?to?noise ratio, edge?dependent fusion quality index and weighted fusion quality index. The results of experiments imply that the new method not only get higher object assessment index score but also get a more clearly fusion image in perceptual than wavelet transform method.

Key words: contourlet transform, image fusion,wavelet transform

引言

图像融合技术经过多年的已在很多方面得到了应用(如国防、医疗、遥感、机器视觉等)。所谓图像融合就是将两幅或两幅以上的源图像组合成一幅包含各源图像显著信息的复合图像,从而获得对某一场景的更全面、清晰的描述。当目前为止,人们提出了不少图像融合方法——从简单的平均值法[1]到更为复杂的神经[2]、模糊聚类[3]、多尺度分析[4,5]方法等。

小波变换以其良好的时频分析特性成为了图像融合的一种重要工具。但是小波变换自身也存在着一些缺点:小波变换的主要缺点在于不能有效地“捕获”图像的方向信息(只有垂直、水平和对角三个方向),方向性的缺乏使得小波不能充分利用图像本身的几何正则性;另一方面,小波变换不能最优地表示含有线或面奇异的高维函数,小波基的支撑区间为不同尺寸大小的正方形,随着分辨率的变细,小波只能用“点”来逼近奇异性曲线,这样便不能稀疏地表示原函数。所以说小波变换并不是最优或者最稀疏的函数表示方法[6,7]。

为了克服以上不足,出现了brushlets[8]、complex wavelets[9]、curvelets[10]等一系列数学表示方法。在受到curvelets的启发下,Minh N. Do 和Martin Vetteri提出了一种“真正”的二维图像表示方法?contourlet变换[6,7]。contourlet变换不仅具有小波变换的主要特征(如多尺度、时频局部性等),而且具有高度的方向性和各向异性等特性。contourlet变换和其他多尺度变换的主要区别在于它在每一尺度上可以有不同的、可变数量的方向数。此外,contoulet变换不像curvelet变换那样从连续域入手,而是先在离散域中设计,而后再将其扩展到连续域中,这样也使得contourlet变换能够更有效的表示离散化的数字图像。综上所述可以看出,在理论上contourlet变换可以用于图像融合,在[11]中作者便将contourlet变换引入到了图像融合应用中。

多数的图像融合应用关注于图像的特征,而不是图像的像素信息。因此,将图像的特征信息加入到图像融合过程中是有意义的。这样做有以下几个优点:更为智能的融合规则;突出图像的特征;减小对噪声、配准不准确等的敏感度;配准和视频融合[12]。迄今为止,研究者们提出了不少基于区域的图像融合方法[3,5,12,13]。鉴于此,我们将contourlet变换用于一种基于区域的融合方法之中,并分别采用有图像和没有参考图像参与评价的融合性能评价方法进行结果分析。实验结果表明,本文方法有良好的融合特性。

1 图像的Contourlet变换

连续的contourlet变换将 L2(R2) 分解为一系列相互正交的多尺度多方向的子空间(如图1所示):

L2(R2)=VJ?(?j≤JWj)

=VJ?(?j≤J(?2lj-1k=0W(lj)j,k)), (j,k)∈Z2.(1)

图1 contourlet变换产生的多尺度多方向子空间

同小波多分辨率分析中定义的一样[14],VJ为近似子空间,尺度函数φ在2J尺度上的平移函数簇:{φJ,n(t)=φJ(t-2jn)}n∈Z2,(2)构成VJ的一组标准正交基。Wj为2j尺度上的细节子空间,通过contourlet变换,Wj被分解为2lj个方向子空间W(lj)j,k,contourlet函数λ在2j尺度上的平移函数簇:{λ(lj)j,k,n(t)=λ(lj)j,k(t-2j-1S(lj)kn)}n∈Z2,(3)构成了紧框架张成方向子空间W(lj)j,k,其中S(lj)k=diag(2lj-1,2), 0≤k<2lj-1

(近似水平方向),(4)

S(lj)k=diag(2,2lj-1), 2lj-1≤k<2lj

(近似垂直方向),(5)这就意味着在近似水平和近似垂直方向,W(lj)j,k的采样网格大小分别为2j+lj-2×2j和2j×2j+lj-2,图2示意了采样网格。这样,对于{lj}j≤J正整数序列,函数簇:{φJ,n,λ(lj)j,k,n}j≤J,0≤k≤2lj-1,n∈Z2,(6)构成了的紧框架,j,k,n分别表示尺度、方向和位置。

令aL(n)=〈f,φL,n〉为函数f(t)∈L2(R2)与尺度函数φL,n的内积,那么图像的离散contourlet变换系数可表示为:{aJ,c(lj)j,k}L c(lj)j,k(n)=〈f,λ(lj)j,k,n〉.(9) 图2 方向子空间W(lj)j,k(近似水平方向)的采样网格 离散contourlet变换可分为两个相互独立的步骤来完成(这正是contourlet变换具有在每个尺度上可以有不同的、可变方向数的关键所在),首先由LP(Laplacian Pyramid)变换对图像进行多尺度分解以“捕获”奇异点,接着利用方向滤波器组DFB(Directional Filter Bank)将同方向的奇异点合成线,最终contourlet变换利用类似于线段(contourlet segment)的基结构来逼近图像。图3为barbara图像的离散contourlet变换。图3 图像的Contourlet变换 2 区域级图像融合 图4给出了本文图像融合方法的框架图(以两幅图像为例),接下来我们将一一介绍其组成部分。 图4 本文算法框架图 Contourlet变换:对源图像进行contourlet变换,提取它们的高频和低频系数。 图像分割:首先,调整源图像的大小,使之与各尺度上的高频图像尺寸相同(在多尺度分解的情况下,将得到两组多尺度图像序列),得到待分割图像;接着对待分割图像进行一次锐化处理,用以获得更好的分割效果;最后使用可控标记分水岭算法对图像进行分割。图5给出了图像分割流程。在进行图像分割时,先待分割图像的梯度图像,作为分割函数;接着主要使用了开—重建和闭—重建两个形态学操作来标记图像中前景物体和背景,得到标记图像;再使用该标记图像修改分割函数,使得梯度图像仅在标记区域内具有极小值;最后,对修改后的分割函数作分水岭变换,从而得到分割图像。分割结束后,将各源图像在不同尺度上对应的分割结果组合起来,形成一组多尺度组合分割图像来指导图像的融合操作。在组合的过程中会产生一些小的区域,但不会出现太多。这是由于前面所述的分割算法不会导致过分分割,而且在接下来的图像边缘单独处理中,这也将得到进一步解决。图5 图像分割流程图 活动度:计算每一区域的活动度,将区域中高频系数绝对值之和作为区域的活动度。 判定:根据待融合图像在每一区域活动度大小判定融合图像对应区域的系数来源。高频和低频系数(仅对于分解的最顶层)均来自活动度较大的区域。 系数融合:根据判定结果进行系数的融合,获得融合图像的高频和低频系数。 Contourlet逆变换:将融合后的系数进行contourlet逆变换,从而得到最终的融合图像。 此外,为了获取更多的图像边缘信息,我们对图像的边缘进行了单独的处理。处理的方法很简单:首先利用膨胀这一形态学操作拓宽边缘,然后对于这些边缘点加窗,求取窗口内高频系数绝对值之和,然后采用最大值选取原则(maximum?selection)融合边缘系数。 3 结果评价与分析 在融合实验中,我们选用了四个评价指标来对结果进行分析,并将其简单的分成两类:一类是均方根误差和信噪比,它们需要有参考图像参加计算;另一类是边缘融合质量指标和加权融合质量指标,它们不需要有参考图像参加计算。

Gemma Piella 和 Henk Heijmans在研究了由Wang和Bovik在[15]中提出的图像质量指标(universal image quality index)的基础上,提出了一种客观的评价方法——边缘融合质量指标EFQI(Edge?Dependent Fusion Quality Index)和WFQI加权融合质量指标(Weighted Fusion Quality Index)[16],该方法不需要有图像。EFQI定义如下:QE(a,b,f)=Qw(a,b,f)1-α·Qw(a′,b′,f′)α,(10)其中QE为EFQI,QW为WFQI,a,b,f分别为原始图像a、b和融合图像f,a′,b′,f′为对应的边缘图像,α为边缘图像贡献率,取值在0和1之间。越接近1,说明评价结果受边缘图像影响越大。WFQI定义如下:QW(a,b,f)=?w∈Wc(w)(λa(w)Q0(a,f|w)

+λb(w)Q0(b,f|w)),(11)

c(w)=C(w)/(?w′∈WC(w′)),(12)

C(w)=max(s(a|w),s(b|w)),(13)s(a|w),s(b|w)为在窗口w内的某些显著的特征,如方差,对比度等。

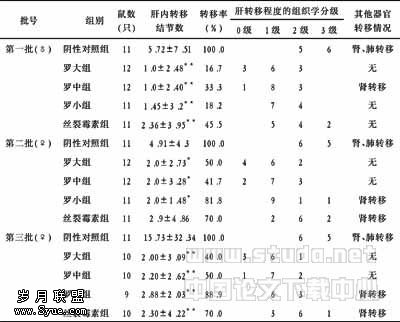

在实验中,Contourlet变换的LP采用的是5?3双正交滤波器,DFB采用haar滤波器,分解层数为1,方向数为4,在EFQI时α取0.5,实验结果与小波变换融合法作比较。实验所用图像、分割图像以及融合结果如图6?9所示,各性能指标如表1所示。 表1 EDFI和WFQI数值比较

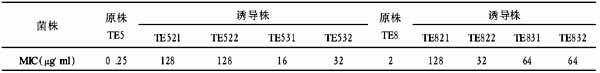

融合方法融合性能指标ClockDiskLab小波变换

融合方法RMSE6.71946.00254.7620SNR(dB)22.919417.845320.0366WFQI0.84500.80730.8670EDFI0.80040.76920.8055本文融合方法RMSE4.04382.43662.6128SNR(dB)27.330225.676425.2502WFQI0.87970.82530.8779EDFI0.83550.81030.8122

从上表中我们看到,通过对本文方法结果进行分析得到的四个指标均比采用小波变换的融合方法要好,尤其是EDFI、SNR明显高于小波变换融合方法。EDFI较高,表明所得的融合结果从源图像中获得了更多的边缘信息,根据HVS(human visual system)可以推测本文的算法更易于人眼的判读;SNR较高,意味图像更加的平滑,清晰。因此,从客观评价上来看,本文算法优于小波变换法。另一方面,我们从视觉的主观方面评测也可以看出本文的算法结果(图9)更加清晰和平滑,尤其在图像的边缘,没有像小波变换法中泛白的颜色和模糊感。

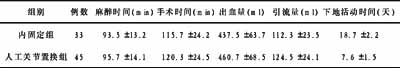

接下来我们利用Disk图像进行实验,考察不同滤波器组合对融合结果的影响(我们没有列出所有组合,在此只是为了说明不同组合对融合结果的影响),各性能指标如表2所示。表2 不同滤波器组合的融合结果

从表中数据可以看出,不同滤波器组合对融合效果的影响不是太大,得分情况上没有太大的差异。引起融合结果不同的主要原因在于,有的滤波器对能够较其他滤波器对更好的“捕获”图像边缘点信息,则在对边缘图像进行单独处理的时候,便能获得较多的边缘信息。

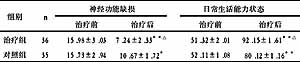

此外,我们使用Lab图像进行实验,考察分解层数对融合结果的影响,实验结果如表3所示。表3 不同分解层数的融合结果

分解层数RMSESNR(dB)WQFIEDFI12.286926.22700.82490.809922.610625.25740.87850.805638.531514.97190.85610.7599

我们可以看到随着分解层数的增加,融合性能在逐渐下降。这主要是因为当分解层数较多时候,可能会导致分割不准确,从而分割结果便不能准确地指导系数融合。此外,注意黑体的一列数据,可以看出,有的时候单靠一种性能评价方法是无法判断融合方法的优劣的,有效地结合各种评价标准来评价一个融合方法的性能是有必要的。

4 结论

本文在基于区域的图像融合框架下,将contourlet变换引入到基于区域的多聚焦图像融合方法中,我们对多幅图像进行了融合实验,并采用了两类不同的性能评价方法进行结果分析,实验结果表明,本文提出的融合方法是有效的。

【参考】

[1]Lallier E, Farooq M. A real time pixel?level based image fusion via adaptive weight averaging[A]. The 3rd International Conference on Information Fusion[C]. Paris, France, 2000.

[2]张兆礼, 孙圣和.基于一维自组织神经的图像数据融合算法研究[J].学报,2000,28(9):74-77.

[3]苏冬雪, 吴小俊.基于多特征模糊聚类的图像融合方法[J].计算机辅助设计与图像学学报, 2006, 18(6):838-848.

[4]Zhang Z, Blum R S. A categorization and study of mutiscale?decomposed?based image fusion schemes with a performance study for a digital camara application[J]. Proceedings of the IEEE, 1999, 87(8):1315-1326.

[5]Piella G. A general framework for mutiresolution image fusion:from pixels to regions[J]. Information Fusion, 2003, 4(4):259-280.

[6]Do M N, Vetterli M. Contourlets[A]. Welland G V. Beyond Wavelets[C].New York: Academic Press,2003.

[7]Do M N,Vetterli M.The contourlet transform: an efficient directional mutiresolution image representation[J]. IEEE Transaction on Image Procesing,2005,14(12):2091-2106.

[8]Meyer F G, Coifman R R.Brushlets: A Tool for Directional Image Analysis and Image Compression[J]. Journal of Appl and Comput Harmonic Analysis, 1997, 6(4):147-187.

[9]Kingsbury N G.Complex wavelets for shift invariant analysis and filtering of signals [J]. Journal of Appl and Comput Harmonic Analysis, 2001, 10(3): 234-253.

[10]Candes E J, Donoho D L. Curvelets: a surprisingly effective nonadaptive representation for objects with edges[A]. Curves and Surfaces[C]. Nashville: Vanderbilt University Press, 1999.

[11]李光鑫,王珂.基于Contourlet变换的彩色图像融合算法[J]. 电子学报, 2007,35(1):112-117.

[12]Lewis J J, O?Callaghan R J, Nikolov S G. Region?based image fusion using complex wavelets[A]. Proceedings of the 7th International Conference on Information Fusion (Fusion 2004)[C]. Stockholm, Sweden, 2004.

[13]Zhang Z, Blum R. Region?based image fusion scheme for concealed weapon detection[A]. Proceedings of 31st Annual Conference on Information Scicences and Systems[C].Baltimore, U.S.A,1997.

[14]Mallat S G. A wavelet Tour of Signal Processing[M]. SanDiego, California:Academic Press, 1998.

[15]Wang Z, Boivk A C. A universal image quality index[J].IEEE signal Processing Letters, 2002,9(3):81-84.

[16]Piella G, Heigmans H. A new quality metric for image fusion[A].Proceedings of IEEE International Conference on Image ProceedingC].Barcelona,Spain,2003.